《真人跳舞轉換為動畫 》這動作契合度比電影的動態捕捉還要棒惹

圖片來自:reddit

原汁原味的內容在這裡

還記得前一陣子在網路上爆紅的AI繪圖嗎?透過人工智能的畫面構築技術,使用者可以在短時間內就得到精緻度高的圖片,開始還會有人詬病AI會有BUG,像是人的手指跟牙齒處理不好,但現在這些問題也進一步獲得改善,可能還有人會說...AI繪圖不會動啊,但大家有注意到現在已經有人釋出AI合成的動圖了嗎?今天跟大家分享的主題「真人跳舞轉換為動畫 」,就帶大家看看近期最新技術的展現

圖片來自:reddit

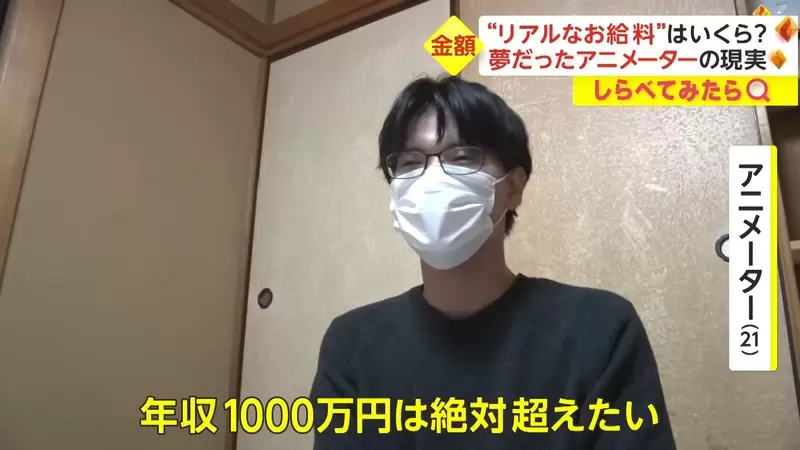

這兩天有網友在討論區貼上一段影片,基本上就是一位真人女孩跳著熱情洋溢的boogie up,但這其實不是該影片的重點,而是有一位二次元人物也在做著相同的動作

圖片來自:reddit

這個技術其實就是透過「Stable diffusion」加上「multiControlNet」兩項技術,把真人跳舞的影片轉換成能動作同步的動畫,雖然...雖然還是能看見一些小瑕疵,像是手指的處理依舊會跑掉,但是整體的流暢度以及穩定度幾乎99.999沒問題,這個就厲害了(拇指),試想這個技術如果可以做延伸,像是結合現在流行的AI繪圖等等,不就可以把AI繪圖不會動的硬傷給解決了嗎?

圖片來自:reddit

相關影片

I transform real person dancing to animation using stable diffusion and multiControlNet

by u/neilwong2012 in StableDiffusion

大家還記得從網路上接收到AI繪圖跟chatGPT的訊息,這時間是多久之前嗎?其實粗略算一下大概還不超過一年(AI繪圖更久一點),現在就有這種技術,那將來電影、電視、動畫、愛情動作片是不是也可以套著用呢?

部分資料來自網路 ( twitterreddit )

0 則回應

順序: 新│舊